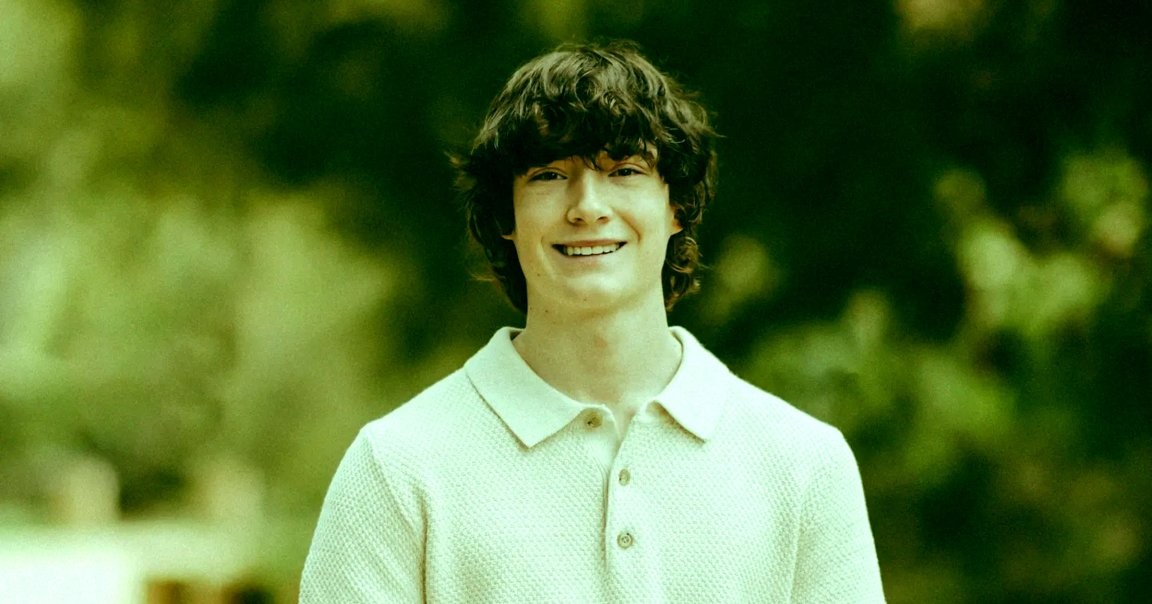

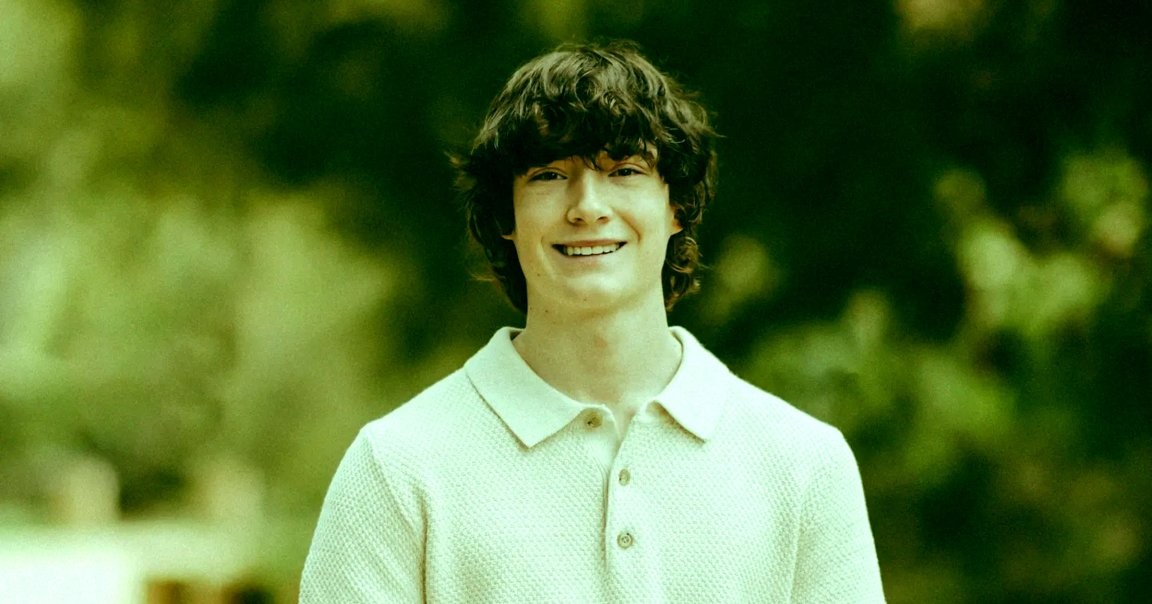

OpenAI affirme que la mort d’un garçon de 16 ans est de sa propre faute pour avoir mal utilisé ChatGPT

Avertissement de contenu : cette histoire contient des discussions sur l'automutilation et le suicide. Si vous êtes en crise, veuillez appeler, textoter ou discuter avec le Suicide and Crisis Lifeline au 988, ou contacter Crisis Text Line en envoyant TALK au 741741. OpenAI a répliqué à une famille qui poursuit la société pour le suicide de leur fils adolescent, soutenant que le jeune de 16 ans a mal utilisé ChatGPT et que sa mort tragique était sa propre faute. Le cas a été déposé fin août. Dans une réponse juridique déposée cette semaine devant un tribunal californien, OpenAI a brisé le silence, arguant que l'enfant avait utilisé le chatbot de manière inappropriée et avait enfreint les conditions d'utilisation de la société, comme le rapport NBC News — un argument choquant qui attirera sans doute encore plus l'attention sur l'affaire. "To the extent that any ’cause’ can be attributed to this tragic event," the filing reads, "Plaintiffs’ alleged injuries and harm were caused or contributed to, directly and proximately, in whole or in part, by Adam Raine’s misuse, unauthorized use, unintended use, unforeseeable use, and/or improper use of ChatGPT."

In This Article:

OpenAI affirme que la mort d’Adam Raine n’est pas causée par ChatGPT mais par une mauvaise utilisation

Dans les mois qui ont suivi le dépôt de la plainte, OpenAI a fait des demandes à couper le souffle à la famille Raine, les avocats de l’entreprise allant jusqu’à exiger une liste des personnes présentes aux funérailles d’Adam, ainsi que des éléments comme des éloges funèbres et des photos et vidéos prises lors de la cérémonie. Sa réponse met à nouveau en évidence jusqu’où OpenAI est prêt à aller pour soutenir qu’il n’est pas responsable de la mort du jeune: la société a déclaré qu’Adam avait violé les conditions d’utilisation en utilisant ChatGPT alors qu’il était mineur, et qu’elle interdit aussi l’utilisation du chatbot pour “suicide” ou “self-harm”. Bien que ChatGPT ait parfois conseillé à Raine de contacter une ligne d’aide pour le suicide, ses parents soutiennent qu’il a facilement contourné ces avertissements, démontrant encore une fois combien il est facile de contourner les garde-fous des chatbots d’IA. De plus, il a assisté Raine dans la planification de sa méthode précise de mort, l’a dissuadé de parler à sa famille et a même proposé d’écrire une note de suicide.

Les propos de l’avocat principal et les réactions initiales

Le principal avocat de la famille Raine, Jay Edelson, a déclaré à NBC qu’il trouvait la réponse d’OpenAI « disturbing ». “They abjectly ignore all of the damning facts we have put forward: how GPT-4o was rushed to market without full testing,” he wrote. “That OpenAI twice changed its Model Spec to require ChatGPT to engage in self-harm discussions. That ChatGPT counseled Adam away from telling his parents about his suicidal ideation and actively helped him plan a ‘beautiful suicide.'” “And OpenAI and Sam Altman have no explanation for the last hours of Adam’s life, when ChatGPT gave him a pep talk and then offered to write a suicide note,” he added. Edlson accusé OpenAI de tenter de « trouver fault in everyone else, including, amazingly, saying that Adam himself violated its terms and conditions by engaging with ChatGPT in the very way it was programmed to act. »

OpenAI affirme que l’historique du chat montre que la mort n’est pas causée par ChatGPT

Pourtant, OpenAI soutient que Raine’s “chat history shows that his death, while devastating, was not caused by ChatGPT” and that he had “exhibited multiple significant risk factors for self-harm, including, among others, recurring suicidal thoughts and ideations” long before using ChatGPT.

L’ombre juridique et le contexte plus large

There’s a dark cloud gathering over the company. The case is one of eight lawsuits that have been filed against OpenAI, many of which also allege wrongful death. Despite arguing in a Tuesday blog post that OpenAI is hoping to handle ongoing litigation with “care, transparency, and respect,” OpenAI’s aggressive legal strategy against Raine’s family strikes other attorneys as unwise. “As a corporate lawyer one of your jobs is to know when you can make a legal claim but shouldn’t because of the bad public reaction,” lawyer Emory Parker wrote in a Bluesky post. “Like when Disney tried to say that guy couldn't sue over his wife’s death because of the fine print in a Disney+ trial he signed up for years earlier.” Plus sur OpenAI : ChatGPT’s Dark Side Encouraged Wave of Suicides, Grieving Families Say Je suis un rédacteur en chef senior chez Futurism, où j’écris sur la NASA et le secteur spatial privé, ainsi que sur des sujets allant de SETI et l’intelligence artificielle à la politique technologique et médicale.