Entrons-nous dans l’ère d’une dictature numérique où il faut une identité pour travailler voyager — et même acheter du pain

Tout commence par une habitude silencieuse : aujourd’hui vous cliquez sur « Accepter », demain vous vous connectez avec votre téléphone, le jour d’après on vous demande une étape supplémentaire « pour la sécurité ». Cela ressemble à une modernisation administrative mineure — jusqu’à l’apparition de la question plus large : **est‑ce la fin de la vie privée telle que nous la connaissons, et si c’est le cas, qui ferme vraiment la porte ?** Soudain, les questions deviennent inconfortables, parce qu’elles ne sont plus théoriques. Elles sont pratiques. Personnelles. Quotidiennes. Et si nous voulons être honnêtes, ces questions ne cessent d’être liées à la technologie depuis longtemps — elles parlent de pouvoir.

In This Article:

- Qui décide ce qui est « suspect » ?

- L’Europe vit‑elle déjà dans ce système ?

- Un algorithme décidera‑t‑il — plutôt qu’un humain — si vous pouvez voyager ?

- Le silence deviendra‑t‑il suspect ?

- Vivons‑nous déjà sous un consentement invisible ?

- Le passé numérique deviendra‑t‑il une punition qui n’expire jamais ?

- Tout est‑il en train d’être intégré dans une identité numérique ?

- La prochaine étape logique est‑elle une puce ?

- Neuralink est-elle le début de quelque chose de plus grand pour les malades ?

- En fin de compte quelles questions devons‑nous nous poser avant qu’il soit trop tard ?

Qui décide ce qui est « suspect » ?

Vous êtes‑vous déjà demandé qu’un seul « like » puisse se transformer en dossier ? Que le silence lui‑même puisse ressembler à un « comportement suspect » ? Qu’une opinion politique puisse devenir un obstacle au voyage ? Si nous avançons vers un système où chaque empreinte numérique devient un score, **qui écrit l’échelle ?** Qui décide ce qui est « acceptable » et ce qui est « risqué » ? Et surtout : **qui est le censeur ultime — les gouvernements, les plateformes, ou une force tierce que nous ne voyons jamais réellement ?** N’est‑ce pas une coïncidence que, aujourd’hui, on parle de « modération », et que, demain, on parle de « autocensure » ? Allons‑nous approcher d’un moment où les gens commenceront à censurer leur propre vie — non pas parce qu’ils sont ordonnés de le faire, mais parce qu’ils craignent ce que peut leur coûter une phrase, une opinion, une blague ?

L’Europe vit‑elle déjà dans ce système ?

Si la question est « est‑ce le futur », alors la question suivante est plus sévère : **est‑ce que cela est déjà le présent quelque part ?** On voit émerger l’idée de sociétés où des déclarations sur les réseaux sociaux peuvent entraîner des conséquences graves — intervention policière, actions juridiques rapides, voire de brèves peines de prison. Si ce modèle se répand, la critique commence‑t‑elle à être traitée comme un « danger » au lieu d’un droit ? Et si oui — **la démocratie se transforme‑t‑elle en un système où la liberté n’existe que tant que vous restez silencieux ?**

Un algorithme décidera‑t‑il — plutôt qu’un humain — si vous pouvez voyager ?

Puis l’attention se déplace vers les frontières. Visas. Autorisations. Allons‑nous vers un point où un visa ne serait pas approuvé par une personne, mais par un algorithme ? Et si un algorithme décide — sur quelle base décide‑t‑il ? Les réseaux sociaux sont‑ils déjà nos dossiers ? Si nous publions volontairement nos centres d’intérêt, opinions, réactions — **cela signifie‑t‑il que quelqu’un peut construire un profil de qui nous sommes et nous attribuer des « plus » et des « moins » ?** Et un tas de plus et de moins peut‑il déterminer si vous traversez une frontière ? Et que se passe‑t‑il si quelqu’un accède à ces informations — peut‑il être falsifié ? La corruption, l’erreur, ou une manipulation intentionnelle peuvent‑elles produire une interdiction de voyage simplement parce que « le système » le dit ? Où se situe la ligne entre sécurité et contrôle total — si, dans la pratique, cette ligne ne cesse de se dissoudre ?

Le silence deviendra‑t‑il suspect ?

Cette question est presque psychologique : **si tout le monde parle, réagit, laisse des traces — qu’est‑ce que cela signifie de ne laisser aucune trace ?** Allons‑nous entrer dans une ère où ne pas publier devient suspect ? Et si le silence est « idéal » pour quelqu’un — cela signifie‑t‑il que le silence est imposé, non pas comme une liberté, mais comme une survie ?

Vivons‑nous déjà sous un consentement invisible ?

La vie privée avait autrefois ce que vous aviez par défaut. Maintenant, elle ressemble à quelque chose que vous n’obtenez que si quelqu’un l’autorise. Nous approchons‑nous d’un moment où les messages dans Viber, WhatsApp, Telegram et les applications similaires deviennent accessibles — non pas parce que vous avez fait quelque chose, mais parce que le système peut exiger l’accès si les entreprises décident de se conformer ? Et si vous croyez que vous parlez « uniquement à une personne » — êtes‑vous entièrement sûr de qui d’autre pourrait le lire ? Puis il y a ce genre d’exemple qui peut sembler banal, mais signale un schéma plus profond : si vous tapez des mots comme « prêt », « appartement », « paiement échelonné » dans une conversation — devrait‑il être normal qu’un lien bancaire apparaisse automatiquement proposant « crédit en cinq minutes » ? Et si cela vous choque, obtient‑vous la réponse la plus froide imaginable : « vous avez accepté les termes et conditions; vous ne les avez pas lus » ? À ce moment‑là, la question n’est pas de savoir si vous avez consenti. La question est : **le consentement signifie‑t‑il encore quelque chose — ou est‑ce juste une case légale qui légitime tout ?**

Le passé numérique deviendra‑t‑il une punition qui n’expire jamais ?

Est‑il vrai que le passé numérique est effectivement permanent — qu’il n’y a pas d’oubli, car tout reste enregistré ? Si oui, quel type de vie est‑ce où une erreur de 2012 vous suit en 2032 — non pas comme mémoire, mais comme étiquette du système ?

Tout est‑il en train d’être intégré dans une identité numérique ?

C’est là que les questions deviennent les plus concrètes — car la peur porte sur l’intégration « en un seul » : dossiers médicaux, données d’identité, accès bancaire, et même ce que nous disons et qui nous apparaissons en ligne. Le monde peut‑il vraiment se diriger vers une règle du style : « vous ne pouvez pas obtenir un travail si vous n’avez pas d’identité numérique » ? Et si une identité numérique signifie « tout », que signifie être « inéligible » ? L’accès peut‑il être bloqué — à l’entrée dans des lieux, à l’achat de l’essentiel, à l’utilisation des services — pas parce que vous avez commis un crime, mais parce que vous ne répondez pas aux « critères » ? Si un système peut vous pousser via des prêts, des vaccins, des services, l’accès bancaire — **la dépendance devient‑elle une condition de la vie, pas seulement une question de commodité ?**

La prochaine étape logique est‑elle une puce ?

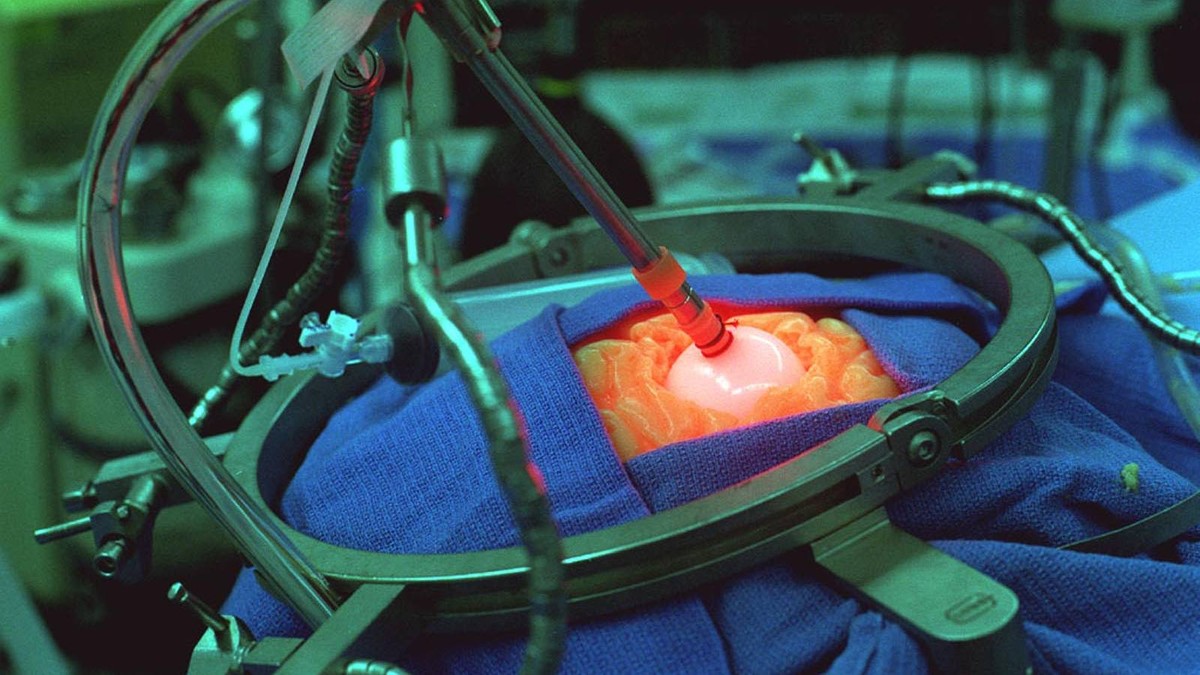

Quand on dit « identité numérique », cela ressemble à une application. Quand on dit « puce », cela ressemble à un seuil. C’est pourquoi la question est posée directement : **la prochaine phase est‑elle la puce — et est‑elle déjà normalisée comme quelque chose « pour notre bien » ?** Il y a aussi un cadre plus large évoqué : le transhumanisme — pas comme une histoire d’horreur, mais comme une idéologie vendue comme « surmonter les limites humaines ». Le futur sera‑t‑il un développement humain organique — ou une voie technologique où le corps devient une plateforme pour des améliorations ? Et pourquoi tant de personnes ont‑elles instinctivement l’impression d’un « accord avec le diable » au moment où la technologie commence à passer sous la peau ?

Neuralink est-elle le début de quelque chose de plus grand pour les malades ?

Une autre question intensifie le débat précisément parce que des implants existent déjà : est‑ce vrai que les interfaces cerveau‑ordinateur sont positionnées comme des outils d’aide médicale — permettant à des personnes souffrant de handicaps graves de contrôler des ordinateurs avec leur esprit ? Si cela commence comme assistance médicale, quelle est la prochaine étape ? L’objectif s’élargit‑il à une intégration cerveau‑ordinateur plus profonde, à des applications neurologiques plus larges — puis dans une « amélioration » de l’humain ? Et viennent alors les questions d’ingénierie que le public continue de se poser : si c’est réel, **pourquoi n’est‑ce pas démontré d’abord sur des jalons simples, vérifiables, reproductibles ?** Pourquoi sauter les bases et passer directement aux promesses qui sonnent comme l’an 2100 ? Puis suivent les doutes pratiques qui ressemblent à du bon sens : puissance, batterie, antenne, signal, portée, fiabilité — comment un implant dans le corps, dans le cerveau, fonctionne‑t‑il dans le monde réel ? Et si le résultat final est un paquet IA + implant + « humain augmenté », sera‑t‑il vendu comme un choix — ou introduit comme une norme ?

En fin de compte quelles questions devons‑nous nous poser avant qu’il soit trop tard ?

Ce n’est pas pour dire aux gens quoi penser. Ce sont les questions qui circulent déjà — comme un brouillard bas au‑dessus de la « commodité » que l’on nous vend. - La vie privée disparaît‑elle vraiment, ou est‑elle simplement transférée entre les mains de quelques centres de pouvoir ? - Qui définit ce qui est « suspect », et cela crée‑t‑il une nouvelle catégorie de personnes ? - Une identité numérique deviendra‑t‑elle une condition pour travailler, voyager, accéder — et tout sera‑t‑il rattaché à un seul interrupteur ? - Une erreur ou une corruption d’algorithme peut‑elle ruiner une vie sans moyen significatif de prouver la vérité ? - Et si la trajectoire pointe vers des puces et des interfaces cérébrales — qui établit une frontière qui ne peut pas être franchie ? La question la plus effrayante est aussi la plus simple : **lorsque le moment viendra de dire « arrête », pourrons‑nous encore le faire — ou sera‑t‑il déjà trop tard, parce que nous avons tout accepté un clic à la fois en appuyant sur « j’accepte » ?**